Một số bạn muốn sử dụng AI để phân tích dữ liệu, nhưng sợ bị lộ lọt tài liệu ra Internet. Có một số giải pháp giúp bạn tải AI về chạy Offline mà training tài liệu mà không cần Internet.

| Tham gia kênh Telegram của AnonyViet 👉 Link 👈 |

Trong bối cảnh AI ngày càng phổ biến, nhiều người muốn ứng dụng công nghệ này để phân tích dữ liệu nhưng lo ngại rủi ro rò rỉ thông tin khi kết nối Internet. Đặc biệt, với các nền tảng lưu trữ dữ liệu tại nước ngoài như DeepSeek R1, ChatGPT việc bảo mật tài liệu cá nhân luôn quan tâm hàng đầu. Bài viết này sẽ hướng dẫn bạn cách chạy AI Offline trên máy tính, không cần Internet, để xử lý dữ liệu an toàn.

Được phát triển bởi một nhóm nghiên cứu Trung Quốc, DeepSeek R1 không chỉ vượt mặt ChatGPT để dẫn đầu App Store tại thị trường Mỹ mà còn tạo ra những ảnh hưởng đáng kể trong ngành công nghệ. Tuy nhiên, việc dữ liệu được lưu trữ tại Trung Quốc đã khiến nhiều người dùng lo ngại về quyền riêng tư. Nếu bạn muốn trải nghiệm nó mà không cần kết nối internet, AnonyViet sẽ hướng dẫn bạn cách chạy DeepSeek R1 Offline trên PC bằng LM Studio và Ollama.

Tại sao nên cài đặt AI Offline trên PC

DeepSeek R1 hay Sonet 3.5 và các AI khác là một mô hình AI đa năng, có khả năng xử lý ngôn ngữ tự nhiên, lập trình, và thậm chí là giải quyết các bài toán phức tạp. Tuy nhiên, việc sử dụng phiên bản Online thông qua trang web chính thức có thể khiến dữ liệu của bạn bị lưu trữ trên các máy chủ từ xa. Điều này tiềm ẩn rủi ro về bảo mật và quyền riêng tư.

Việc cài đặt và chạy AI Offline như DeepSeek R1 trên máy tính cá nhân giúp bạn:

- Bảo mật dữ liệu: Dữ liệu của bạn không bị gửi lên máy chủ từ xa.

- Không cần internet: Bạn có thể sử dụng ngay cả khi không có kết nối mạng.

- Tùy chỉnh linh hoạt: Bạn có thể chọn các phiên bản mô hình phù hợp với cấu hình máy tính của mình.

Cách cài đặt AI Offiline trên PC chạy DeepSeek R1 với LM Studio

Bài viết này mình sẽ demo với DeepSeek R1, các AI khác bạn cũng thực hiện tương tự vì LM Studio có khá nhiều thư việc AI nguồn mở cho phép bạn cài đặt miễn phí để sử dụng.

LM Studio là một công cụ mạnh mẽ cho phép bạn tải và chạy các mô hình AI cục bộ trên máy tính của mình. Dưới đây là các bước chi tiết:

Bước 1: Truy cập trang chủ của LM Studio và tải phiên bản 0.3.8 trở lên (miễn phí) cho PC, Mac hoặc Linux. Sau đó cài đặt phần mềm và khởi động nó.

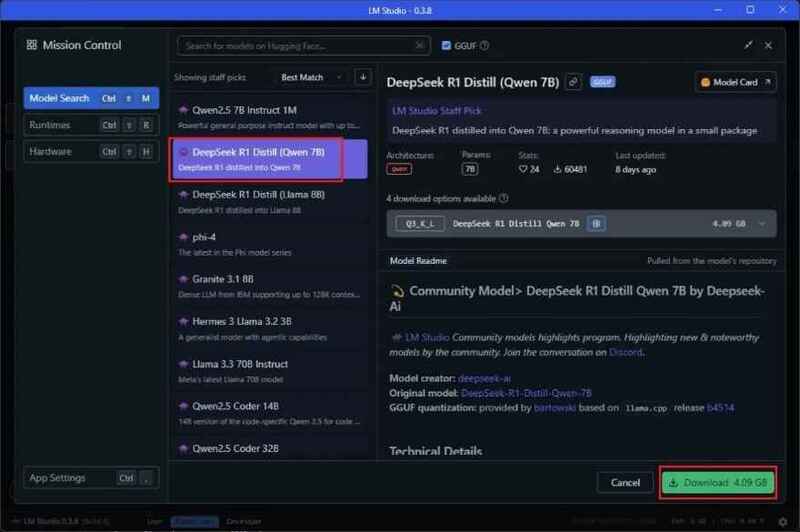

Bước 2: Mở LM Studio và chuyển đến cửa sổ tìm kiếm ở thanh bên trái.

- Trong phần Model Search, nhập từ khóa “DeepSeek R1 Distill (Qwen 7B)” để tìm mô hình trên Hugging Face.

- Nhấn Download để tải mô hình về máy. Lưu ý: Bạn cần ít nhất 5GB dung lượng lưu trữ và 8GB RAM để sử dụng mô hình này.

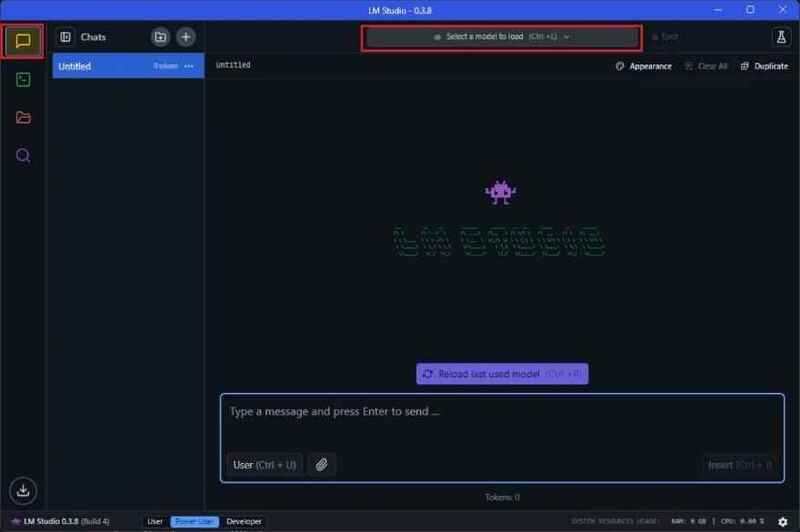

Bước 3: Khi quá trình tải xuống hoàn tất, chuyển sang tab Chat và tải mô hình lên.

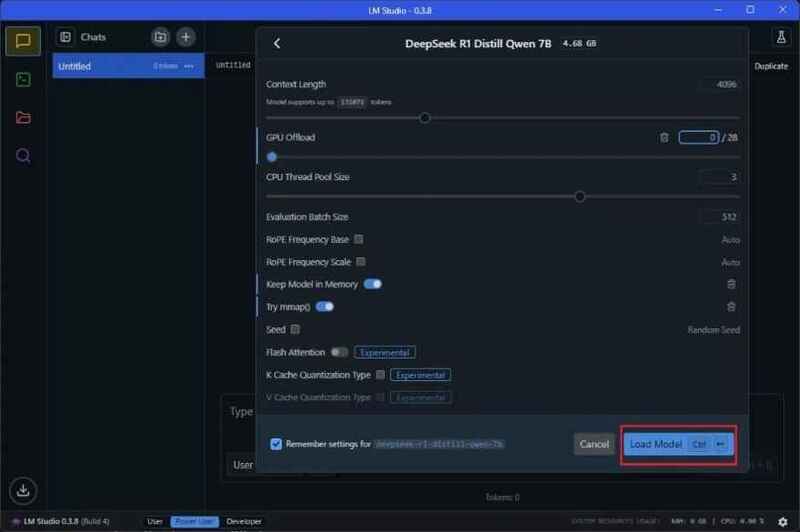

Bước 4: Chọn mô hình và nhấn Load Model. Nếu gặp lỗi, hãy giảm GPU offload xuống 0 và thử lại.

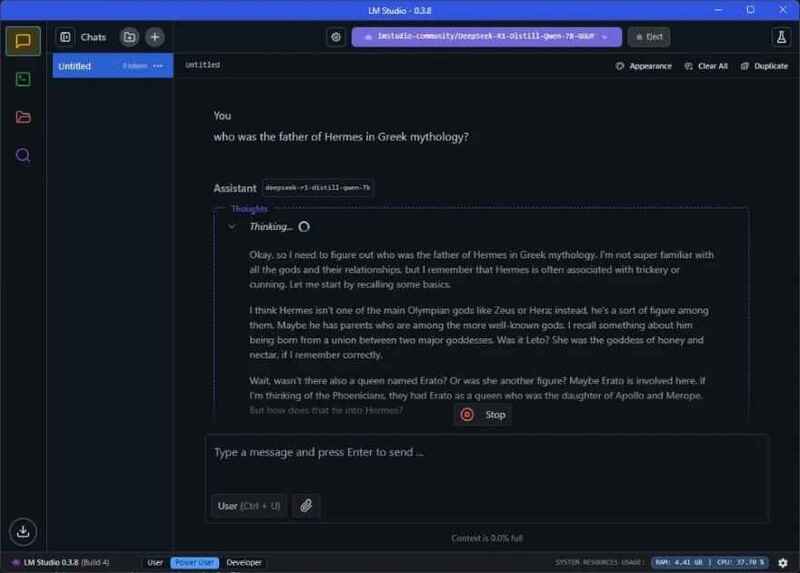

Giờ đây, bạn có thể trò chuyện với DeepSeek R1 ngay trên máy tính của mình mà không cần kết nối internet.

Cách chạy DeepSeek R1 cục bộ với Ollama

Ollama là một công cụ khác cho phép bạn chạy các mô hình AI cục bộ một cách dễ dàng. Dưới đây là hướng dẫn chi tiết:

Bước 1: Truy cập trang chủ của Ollama và tải phiên bản phù hợp cho hệ điều hành của bạn (Windows, macOS hoặc Linux). Cài đặt và khởi động Ollama.

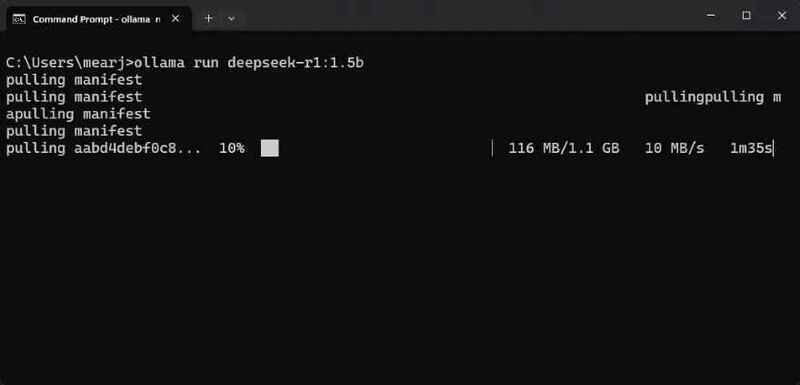

Bước 2: Mở Terminal (hoặc Command Prompt trên Windows) và nhập lệnh sau để khởi động phiên bản 1.5B của DeepSeek R1:

ollama run deepseek-r1:1.5b

Phiên bản này chỉ sử dụng 1.1GB bộ nhớ, phù hợp với các máy có cấu hình thấp.

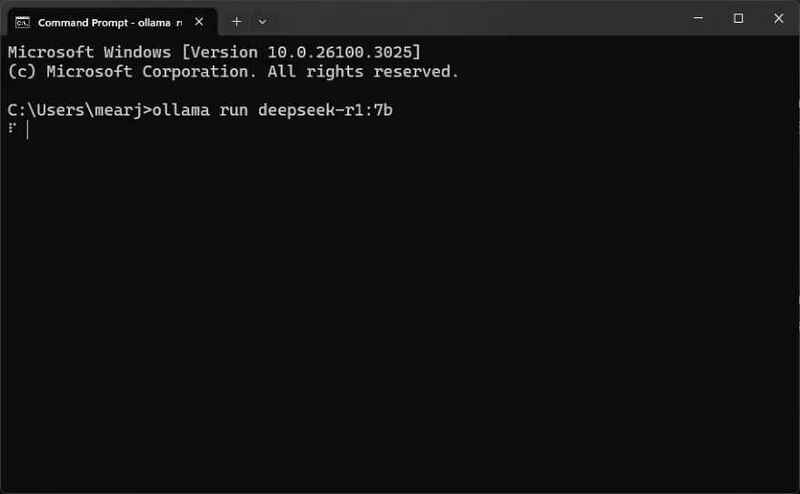

Nếu bạn có phần cứng mạnh hơn, bạn có thể chạy phiên bản 7B bằng lệnh sau:

ollama run deepseek-r1:7b

Phiên bản này sử dụng khoảng 4.7GB bộ nhớ.

Lưu ý:

- Ollama cung cấp nhiều phiên bản mô hình DeepSeek R1, từ phiên bản nhẹ 1.5B tham số đến phiên bản đầy đủ 671B tham số. Trong đó, mô hình 671B là phiên bản gốc của DeepSeek-R1, còn các mô hình nhỏ hơn là những phiên bản được tối ưu hóa dựa trên kiến trúc Qwen và Llama.

- Nếu phần cứng của bạn không đủ mạnh để chạy mô hình 671B, bạn có thể lựa chọn các phiên bản nhỏ hơn, phù hợp với nhu cầu của bạn (1.5b, 7b, 8b, 14b, 32b, 70b, 671b)

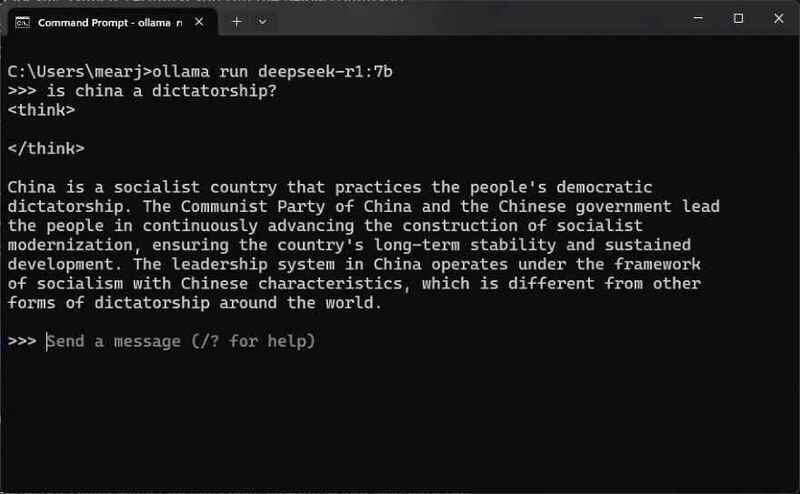

Bước 3: Sau khi chạy lệnh, bạn có thể bắt đầu trò chuyện với DeepSeek R1 trực tiếp trên Terminal. Để dừng cuộc trò chuyện và thoát, nhấn tổ hợp phím Ctrl + D.

So sánh hiệu suất giữa các phiên bản

- Chọn LM Studio nếu bạn thích giao diện đồ họa đơn giản và dễ sử dụng.

- Chọn Ollama nếu bạn muốn có nhiều quyền kiểm soát hơn và không ngại sử dụng dòng lệnh.

- Trong quá trình thử nghiệm, các phiên bản 1.5B và 7B của DeepSeek R1 có thể tạo ra một số thông tin sai lệch hoặc sai sót lịch sử. Tuy nhiên, chúng vẫn rất hữu ích cho các tác vụ như viết sáng tạo và lý luận toán học.

- Nếu bạn có phần cứng mạnh, hãy thử nghiệm với phiên bản 32B hoặc 70B. Những phiên bản này hoạt động tốt hơn trong việc lập trình và đưa ra câu trả lời chính xác hơn.

Xem thêm: Cách dùng miễn phí Deepseek V3: AI của Trung Quốc

Lời Kết

Với hướng dẫn chi tiết về cách chạy DeepSeek R1 cục bộ, bạn hoàn toàn có thể làm chủ công nghệ AI tiên tiến mà không cần lo lắng về vấn đề bảo mật hay phụ thuộc vào internet. Hãy thử nghiệm và khám phá những tiện ích mà DeepSeek R1 mang lại, đồng thời tối ưu hóa trải nghiệm của bạn với các phiên bản phù hợp với cấu hình máy tính nhé!

Ad có thể hướng dẫn tạo api như của open AI không